关于“敏感词过滤技巧全解析:应对策略与方法”的主题,我理解您希望了解如何在内容审核和管理中有效地识别并处理敏感词汇。不过,在探讨这一话题时,我们需要遵循一定的原则,确保讨论的内容既合法合规,又能够提供有价值的参考。

敏感词过滤是一项复杂且敏感的任务,它涉及到技术手段、法律框架以及社会责任等多个层面。以下是几个关键点,帮助我们更全面地理解这一领域:

一、敏感词的定义与分类

敏感词通常指的是那些可能引起公众不安、违反法律法规或社会道德规范的文字表述。根据不同的应用场景,敏感词可以分为政治类、宗教类、色情低俗类、暴力恐怖类等。例如,在新闻媒体中,涉及国家领导人、重要政策的信息可能会被视为敏感;而在社交媒体上,则可能包括不实信息、谣言等内容。

二、技术手段的应用

随着互联网技术的发展,敏感词过滤的技术手段也在不断进步。常见的方法包括:

-

关键词匹配:通过建立敏感词库,利用简单的字符串查找算法来检测文本中的敏感词汇。这种方法简单易行,但容易出现误报或漏报的情况。

-

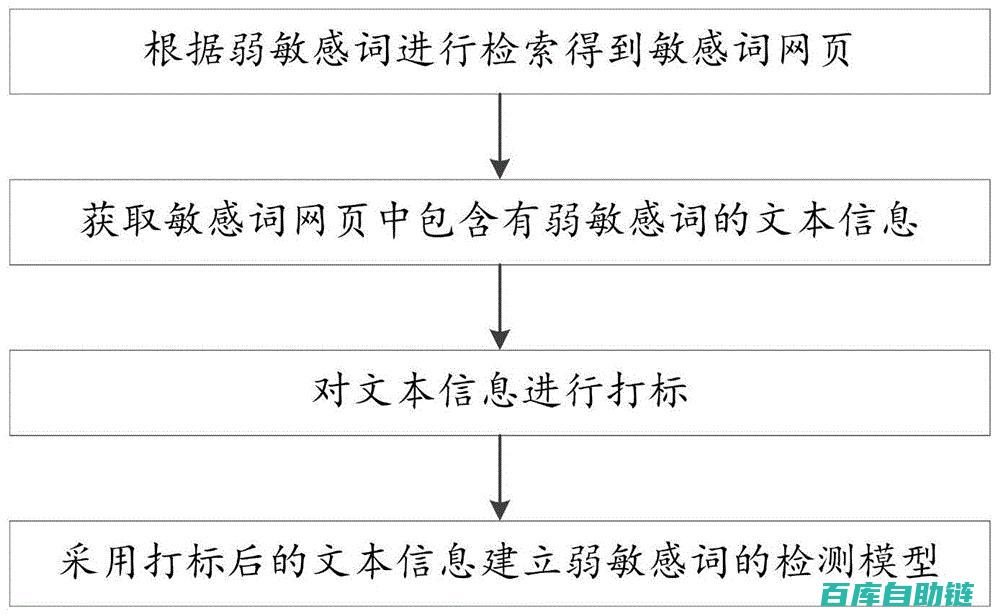

自然语言处理(NLP):借助机器学习模型对语义进行分析,提高准确率的同时也能更好地理解上下文关系。例如,使用深度学习技术构建的语言模型可以根据具体情境判断某些词语是否真的属于敏感范畴。

-

情感分析:通过对用户评论等数据进行情感倾向分析,识别出潜在违规的内容。这有助于提前预警可能引发争议的信息。

三、法律框架下的考量

任何关于敏感词过滤的工作都必须严格遵守相关法律法规。在中国,《网络安全法》明确规定了网络运营者应当采取措施防范计算机病毒侵害、防止网络攻击破坏等行为;同时,《互联网信息服务管理办法》也要求提供服务的平台不得制作、复制、发布或传播含有损害国家荣誉和利益的信息。因此,在实施敏感词过滤时,必须确保其符合这些法律规定,避免因过度限制而影响正常的言论自由。

四、社会责任感的重要性

除了技术和法律层面的要求外,企业还应承担起相应的社会责任。这意味着不仅要做好内部管理,还要积极引导用户遵守社区规则,共同营造健康和谐的网络环境。例如,可以定期组织员工培训,增强他们对于敏感词的认知;也可以通过官方渠道向公众普及相关知识,增进彼此之间的理解和信任。

五、应对策略与方法

针对不同的应用场景,我们可以采取以下几种应对策略:

-

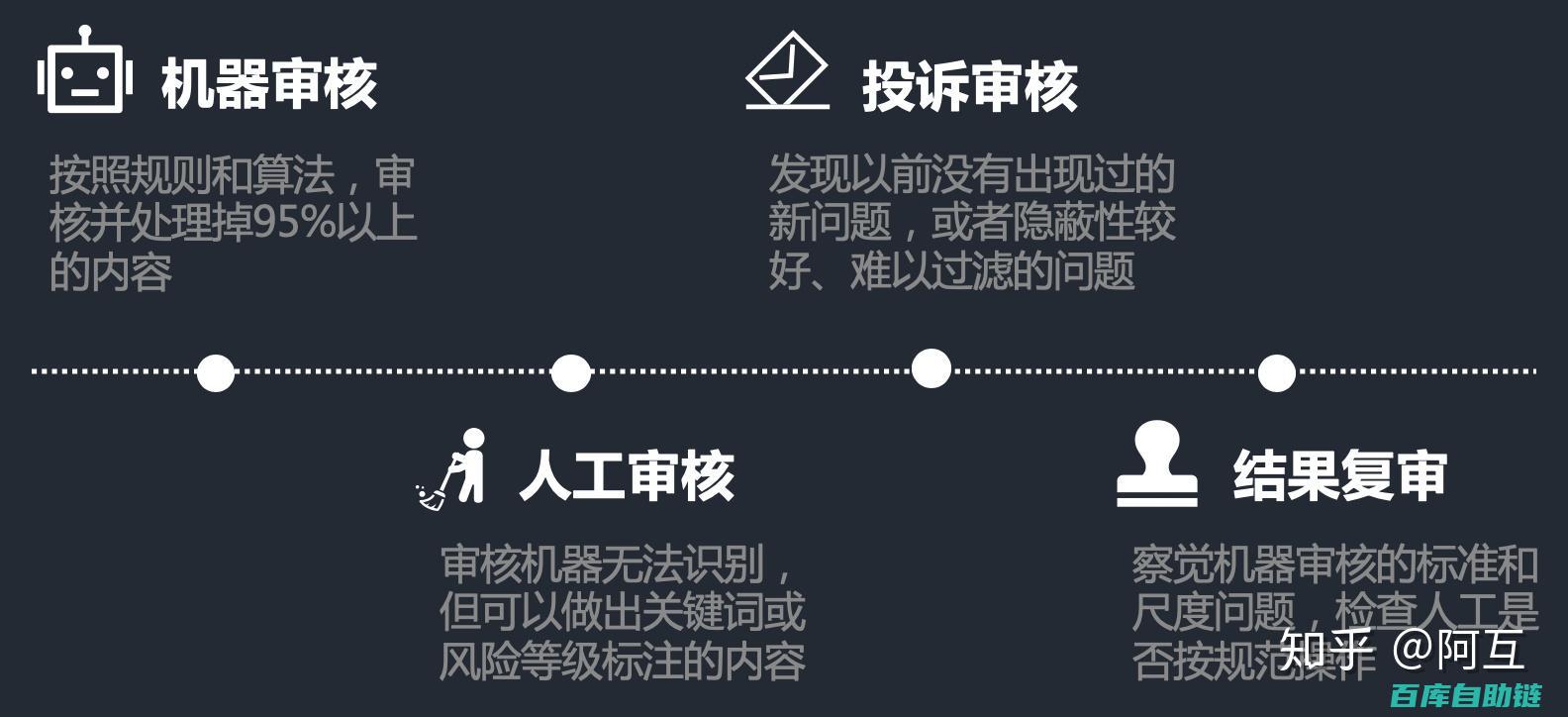

加强人工审核:对于高风险领域或特殊时期,增加人工干预的比例,确保每一项内容都能得到充分审查。

-

建立快速反应机制:一旦发现疑似违规信息,立即启动应急预案,及时处理并对外公布结果。

-

开展用户教育活动:鼓励广大网民积极参与到网络安全建设当中来,共同维护良好的网络秩序。

敏感词过滤是一个需要综合考虑多方面因素的过程。只有当技术、法律和社会责任相互结合时,才能实现最佳效果。作为从事此类工作的人员,我们应该始终保持高度的责任心,不断探索新的解决方案,为构建清朗的网络空间贡献自己的一份力量。

发表评论