在当今数字化时代,互联网平台的快速发展带来了海量的信息传播,同时也伴随着信息过载、虚假信息泛滥等问题。为了确保网络环境的健康与安全,内容审核成为各大平台的重要任务之一。本文将从关键环节和优化策略两个方面,深入解析内容审核流程的设计。

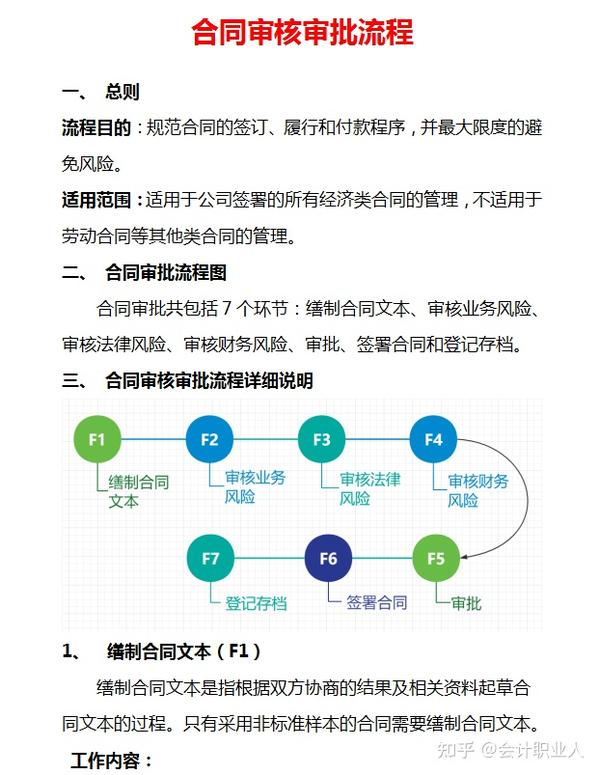

一、内容审核流程中的关键环节

1. 信息采集:这是内容审核的第一步,涉及如何获取待审核的内容。对于大多数社交媒体平台而言,信息采集主要依赖于用户的上传行为。信息采集也可能来自其他渠道,例如第三方网站或API接口提供的数据。在此过程中,平台需要考虑如何平衡信息采集的广度与深度,既要确保覆盖尽可能多的潜在违规内容,又要避免过度采集导致用户隐私泄露。

2. 初步筛选:初步筛选是通过自动化工具快速过滤掉明显不符合要求的内容。这一阶段通常使用关键词过滤、图像识别等技术手段来判断内容是否属于敏感类别。例如,在社交媒体平台上,可能会设置禁止传播暴力、色情、仇恨言论等内容的规则。初步筛选的目标是减少人工审核的工作量,提高整体效率。

3. 人工审核:尽管自动化工具可以处理大量日常事务,但对于复杂或模糊不清的情况,仍需依赖人工介入。人工审核者需要具备一定的专业知识背景,并接受相关培训,以便准确识别违规内容并做出适当处理。他们还需要考虑到不同文化和语言背景下可能存在的差异,以确保决策的一致性和公平性。

4. 反馈机制:为了持续改进审核流程,建立有效的反馈机制至关重要。这包括收集用户举报信息、定期审查已处理案例等措施。通过这些途径,平台可以更好地了解哪些方面存在不足之处,并据此调整策略。

5. 持续更新规则库:随着社会趋势和技术进步,原有的规则可能不再适用。因此,保持规则库的灵活性和适应性非常重要。这意味着需要不断监测新出现的问题,并将其纳入到新的审核标准中去。

二、优化策略

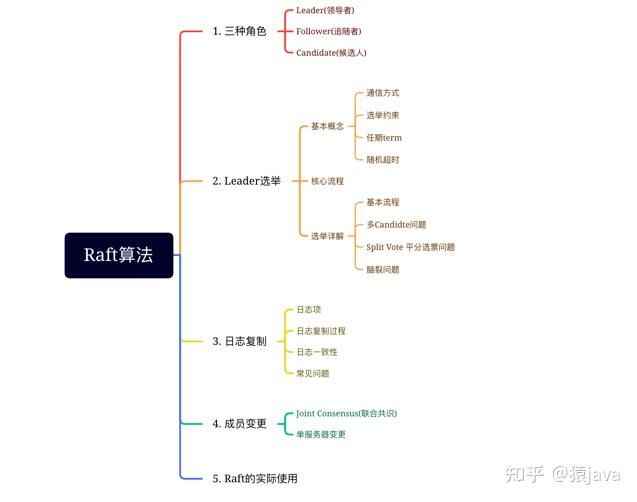

1. 引入机器学习算法:利用先进的机器学习模型可以显著提升审核过程中的准确性。特别是对于那些难以用简单规则定义的问题,如低俗语言、不当表情包等,机器学习能够提供更精准的支持。同时,通过不断训练模型,使其逐渐学会区分不同类型的内容,从而实现更加智能化的管理。

2. 加强团队建设:拥有一支高素质的专业队伍对于维持高质量的内容审核至关重要。除了基本的技术能力外,还应注重培养员工的职业道德感和社会责任感,鼓励他们在工作中积极践行企业的价值观。

3. 强化用户教育:虽然我们的目标是减少违规内容的存在,但更重要的是预防它们的发生。为此,可以通过开展宣传活动、举办讲座等形式向公众普及正确的网络礼仪知识,帮助用户树立正确的价值观。

4. 促进跨部门合作:内容审核不仅仅是技术部门的事情,它涉及到法律、市场等多个领域。因此,各相关部门之间应当加强沟通协作,共同制定出更为科学合理的政策框架。

5. 采用多方共治模式:除了依靠内部力量之外,还可以邀请外部专家、学者以及普通民众参与到平台治理当中来。这样不仅可以拓宽视野,还能增强社会公众对平台的信任度。

发表评论